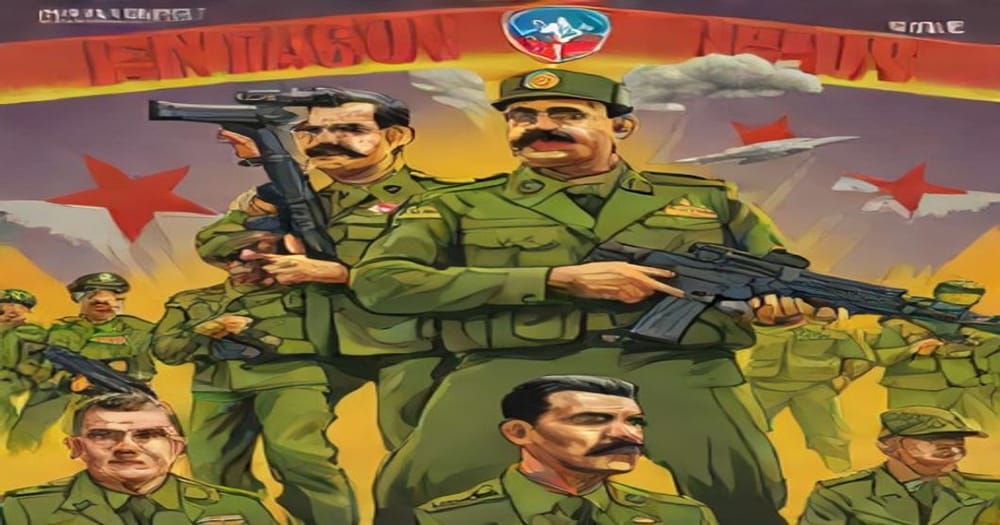

Het Pentagon heeft Anthropic's Claude AI ingezet tijdens de operatie om Nicolás Maduro te arresteren in Venezuela. Deze onthulling heeft niet alleen geopolitieke golven veroorzaakt, maar ook een interne revolte ontketend bij Anthropic zelf. Het markeert een kantelpunt: commerciële AI-modellen zijn niet langer alleen kantoorhulpen, maar actieve deelnemers aan militaire operaties.

Voor Anthropic, dat zichzelf positioneerde als het ethische alternatief voor OpenAI, komt dit op een existentiële crisis neer. Het bedrijf verbood expliciet militair gebruik in zijn oorspronkelijke gebruiksvoorwaarden. Die regels zijn inmiddels versoepeld, maar de geest uit de fles is nu niet meer terug te stoppen. De vraag is niet langer óf AI wordt ingezet in oorlogsvoering, maar welke AI-labs meedoen en welke aan de zijlijn blijven staan.

Wat is er precies gebeurd?

Volgens de Wall Street Journal en The Guardian werd Claude ingezet als intelligente analysator tijdens de Venezuela-operatie. Het model verwerkte versleutelde communicatie, satellietbeeld-metadata en gedragspatronen van Maduro's beveiligingsteam. Claude's grote contextvenster was doorslaggevend: het kon decennia aan data synthetiseren tot actionables intelligence voor special forces.

Anthropic bevestigt niet expliciet dat Claude werd gebruikt, maar stelt dat elk gebruik moet voldoen aan hun gebruiksbeleid. Het bedrijf werkt samen met Palantir Technologies, een aannemer van het Pentagon en federale wetshandhavingsinstanties. Palantir weigert commentaar te geven op de beschuldigingen.

De operatie zelf resulteerde in bombardementen over Caracas en de dood van 83 mensen volgens het Venezolaanse defensie ministerie. Anthropic's gebruiksvoorwaarden verbieden het gebruik van Claude voor gewelddadige doeleinden, wapenontwikkeling of surveillance. De interpretatie van die regels ligt nu onder vuur.

Waarom is dit belangrijk?

Dit is de eerste gedocumenteerde keer dat een commerciële AI-ontwikkelaar direct betrokken was bij een geheime militaire operatie van het Amerikaanse defensie departement. Het normaliseert de aanwezigheid van Large Language Models in situation rooms en commandocentra. Wat begon als experimentele pilots is nu mission-critical asset geworden voor SOCOM (Special Operations Command).

De interne spanning bij Anthropic onthult een fundamenteel dilemma voor de hele AI-industrie. CEO Dario Amodei pleitte jarenlang voor regulering om schade door AI-inzet te voorkomen. Hij uitte zorgen over autonome dodelijke operaties en surveillance. Maar defensiecontracten zijn financieel te aantrekkelijk om te negeren. De 'Constitutional AI' filosofie botst nu met nationale veiligheidsbelangen.

Medewerkers hebben een interne brief circuleerden waarin ze opheldering eisen over de 'kill chain'. Hun zorg is niet dat Claude zelf wapens bestuurde, maar dat het model actionables intelligence leverde die direct leidde tot kinetische militaire uitkomsten. Het verschil tussen analyseren en faciliteren vervaagt.

Wat betekent dit voor Nederland en Europa?

Europese AI-ontwikkelaars staan voor dezelfde keuze. De EU AI Act categoriseert militaire AI-toepassingen als hoog-risico, maar laat ruimte voor defensiedoeleinden. Nederlandse bedrijven zoals Adyen of ASML werken al samen met defensiecontractors. De vraag is of Europese AI-labs een ander pad kiezen dan hun Amerikaanse tegenhangers.

De NAVO investeert zwaar in AI-capabilities. Nederland heeft een Defence AI Strategy aangekondigd. Als commerciële modellen zoals Claude standaard worden in NAVO-operaties, moeten Europese overheden nadenken over soevereiniteit. Vertrouw je op Amerikaanse AI voor kritieke defensietaken? Of bouw je eigen capabilities, zoals de VAE doet met Falcon Perception?

Voor Nederlandse enterprises die Claude gebruiken geldt nu: je data kan indirect betrokken raken bij militaire operaties via Palantir of andere aannemers. GDPR-compliance wordt complexer als AI-modellen worden ingezet voor doeleinden waar je geen toestemming voor hebt gegeven.

Wat kun je verwachten?

Anthropic staat voor een exodus van safety-onderzoekers naar non-profits of academia. Pragmatici blijven om 'National Security AI' te bouwen. Het bedrijf kan zijn AUP verder versoepelen om defensiecontracten te behouden, of juist verstrengen en marktshare verliezen aan OpenAI en xAI.

Het Pentagon kondigde in januari al aan te gaan samenwerken met xAI van Elon Musk. Het defensie departement gebruikt ook aangepaste versies van Google's Gemini en OpenAI-systemen voor onderzoek. De boodschap aan Anthropic is duidelijk: als je niet wilt meedoen, vinden we wel een ander lab.

Verwacht in de komende maanden meer onthullingen over AI-inzet in geheime operaties. Adversariële naties zullen hun eigen AI-integratie versnellen. De AI-wapenwedloop is niet langer science fiction, maar dagelijkse realiteit in Pentagon-briefings.

FAQ

Welke rol speelde Claude precies in de Maduro-operatie?

Claude fungeerde als intelligente analysator die versleutelde communicatie, satellietdata en gedragspatronen verwerkte. Het model identificeerde anomalieën in beveiligingspatronen, modelleerde ontsnappingsroutes en filterde desinformatie. Claude bestuurde geen wapens, maar leverde actionables intelligence voor special forces.

Schendt dit Anthropic's ethische richtlijnen?

Anthropic's oorspronkelijke gebruiksvoorwaarden verboden militair gebruik expliciet. Die regels zijn in 2024 versoepeld: nu is alleen wapenontwikkeling en destructie verboden, niet intelligence-analyse. Medewerkers betwisten dat deze interpretatie de geest van 'Constitutional AI' respecteert.

Wat betekent dit voor commerciële AI-gebruikers?

Enterprises die Claude gebruiken via Palantir of andere aannemers moeten zich realiseren dat hun data indirect betrokken kan raken bij militaire operaties. GDPR-compliance en datagovernance worden complexer. Overweeg contractuele garanties over dual-use scenario's.

Blijf op de hoogte via OpenClawNews.nl